深度学习触发AI革命,AI+安防最先布局

过去5年间,计算能力的大幅进步触发了AI革命,谷歌母公司Alphabet、亚马逊、苹果、Facebook以及微软等科技巨头争先进入这个领域。尤其是自去年人工智能机器人大与人类棋手开展,人工智能关注度达到了一个新的高峰。其实,人工智能的发展可以追述到60几年前,但是因为技术的原因数次沉寂,直到深度学习的出现,让人工智能再次掀起热潮。

深度学习再度点燃人工智能 安防成重点领域

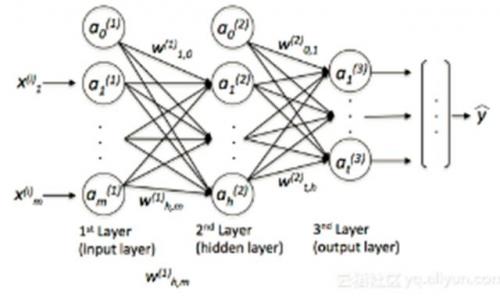

什么是深度学习?

深度学习是机器学习方法之一,而机器学习则是让计算机从有关我们周围世界或其中某个特定方面的范例中学习,从而让计算机变得更加智能的一种方式。在所有的机器学习方法中,深度学习是最独特的,因为它的灵感源自我们对人脑探索与研究。深度学习试图让计算机学会很多不同层次的抽象和表达,这可能是使此类系统如此成功的原因。

为何安防行业成深度学习重点?

安防领域是个时刻都能产生海量数据的行业,近两年在AI技术的加持之下,这些数据正在产生新的意义,为安防这个传统行业解决更多问题。

安防行业作为人工智能技术天然的训练场和应用场,对于人工智能的落地应用有着迫切的需求,基于安防行业的天然属性,安防行业在人工智能化市场有着深入的投入。出于对市场的敏感,主流的设备解决方案供应商已经发力布局已经纷纷入局,凭借其各自深耕安防行业的经验,都在应用落地取得了不俗的成绩。其中,深度学习方面取得的成绩尤为突出,成为点燃人工智能发展的关键技术。

深度学习主要的研究领域在语音识别和视觉方面,而且将深度学习应用到各个方向,可以不同的领域做出不同的技术创新。对于掌握了许多视频图像资源的安防行业来说,深度学习和安防的结合拥有比较高的契合度,即对图像和视频的分析,包括:

——在图像分析方面,比如人们熟悉的人脸识别、文字识别和大规模图像分类等,深度学习大幅提升了复杂任务分类的准确率,使得图像识别、语音识别,以及语义理解准确率大幅提升。

——在人脸方面,可以实现人脸检测、人脸关键点定位、身份证对比、聚类以及人脸属性、活体检测等等。在智能监控方面,可以做人、机动车、非机动车视频结构化研究。

——在文字方面,小票的识别、信用卡的识别、车牌的识别,这些都是由深度学习的算法来做的。同时在图像的处理方面,在去雾、超分辨率、去抖动、去模糊,HDR、各种智能滤镜的设计都是用深度学习的算法。

安防行业深度学习主要集中在体分析(人脸识别、人体特征提取技术)、车辆分析(车辆识别技术、车辆特征提取技术)、行为分析(目标跟踪检测技术、异常行为分析技术)、图像分析(视频质量诊断技术、视频摘要分析技术)四大块上。随着深度学习算法的突破,目标识别、物体检测、场景分割、人物和车辆属性分析等智能分析技术,都取得了突破性进展。

“AI+安防”潮流来袭

根据前瞻产业研究院《中国互联网+安防行业发展前景预测与投资战略规划分析报告》显示,近年来,随着安防需求不断提升。我国安防行业市场规模从2010年的2350亿元增长到2016年的5400亿元,年复合增长率达到15%。

值得一提的是,与传统安防手段相比,新一代安防技术正借助人工智能、云计算、大数据、物联网、移动互联等技术,实现多元化快速发展,“AI+安防”正给人们带来一个更加“聪明”的安全时代。

据中安协发布的《中国安防行业“十三五”(2016—2020年)发展规划》,“十三五”期间,安防行业将向规模化、自动化、智能化转型升级。到2020年,安防企业总收入达到8000亿元左右,年增长率达到10%以上。

“未来4到5年,安防将进入一个人工智能高速发展的时代。”国内安防企业宇视科技副总裁闫夏卿表示,安防行业2016年基本完成了场景智能的适配;2017年、2018年将进入以深度学习为基础的人工智能阶段;到2019年、2020年将全面进入到数字智能的阶段。最终,经过数字智能阶段后,安防行业的人工智能将全面的和全行业、全IT的大数据业务平台进行完善的对接,安防也进入智能时代。

除了赢得产业巨头们的积极响应之外,“AI+安防”还获得了国家层面的政策加持。

2016年6月份,工信部等部门发布的《“互联网”人工智能三年行动实施方案》指出,智能安防将作为人工智能产品创新的重点应用推广领域。《方案》提出,实施智能安防推广工程,鼓励安防企业与互联网企业开展合作,研发集成图像与视频精准识别、生物特征识别、编码识别等多种技术的智能安防产品,推动安防产品的智能化、集约化、网络化。

结语:现阶段,不仅安防行业,越来越多的产业和企业在深度学习领域进行探索。当然我们也期待在深度学习甚至是人工智能的影响和各个安防生厂商的创新下,更多的智能安防产品能迅速落地应用,提高城市安防系统的工作效率!

在线留言询价

深度学习潜力无穷

- 一周热料

- 紧缺物料秒杀

| 型号 | 品牌 | 询价 |

|---|---|---|

| TL431ACLPR | Texas Instruments | |

| CDZVT2R20B | ROHM Semiconductor | |

| RB751G-40T2R | ROHM Semiconductor | |

| BD71847AMWV-E2 | ROHM Semiconductor | |

| MC33074DR2G | onsemi |

| 型号 | 品牌 | 抢购 |

|---|---|---|

| BP3621 | ROHM Semiconductor | |

| TPS63050YFFR | Texas Instruments | |

| ESR03EZPJ151 | ROHM Semiconductor | |

| STM32F429IGT6 | STMicroelectronics | |

| BU33JA2MNVX-CTL | ROHM Semiconductor | |

| IPZ40N04S5L4R8ATMA1 | Infineon Technologies |

AMEYA360公众号二维码

识别二维码,即可关注